獨立磁盤冗餘數組(RAID, Redundant Array of Independent Disks)簡稱磁盤數組,其基本思想就是把多個相對便宜的硬盤組合起來,成爲一個磁盤數組組,使性能達到甚至超過一個價格昂貴、容量巨大的硬盤。根據選擇的版本不同,RAID比單顆硬盤有以下一個或多個方面的好處:增強數據集成度,增強容錯功能,增加處理量或容量。另外,磁盤數組組對於電腦來說, 看起來就像一個單獨的硬盤或邏輯存儲單元。分爲RAID-0,RAID-1,RAID-1E,RAID-5,RAID-6,RAID-7,RAID-10,RAID-50。

簡單來說,RAID把多個硬盤組合成爲一個邏輯扇區,因此,操作系統只會把它當作一個硬盤。RAID常被用在服務器電腦上,並且常使用完全相同的硬盤作爲組合。由於硬盤價格的不斷下降與RAID功能更加有效地與主板集成,它也成爲了玩家的一個選擇,特別是需要大容量存儲空間的工作,如:視頻與音頻製作。

象小io的數據庫類型操作,如ERP等等應用,建議採用RAID10,而大型文件存儲,數據倉庫,如醫療PACS系統、視頻編輯系統則從空間利用的角度,建議採用RAID5。下面請看詳細的性能對比:

本文上部分側重分析兩種RAID的內部運行原理,下部分將根據不同的影響磁盤性能的因素來分析,RAID方案對磁盤系統的影響

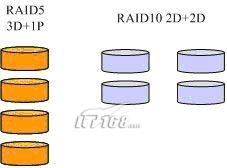

爲了方便對比,我這裏拿同樣多驅動器的磁盤來做對比,RAID5選擇3D+1P的RAID方案,RAID10選擇2D+2D的Raid方案,分別如圖:

那麼,我們分析如下三個過程:讀,連續寫,隨機寫,但是,在介紹這三個過程之前,我需要介紹另外一個磁盤陣列中的重要概念:cache。

磁盤讀寫速度的關鍵之一:Cache

cache技術最近幾年,在磁盤存儲技術上,發展的非常迅速,作爲高端存儲,cache已經是整個存儲的核心所在,就是中低端存儲,也有很大的cache存在,包括最簡單的RAID卡,一般都包含有幾十,甚至幾百兆的RAID cache。

cache的主要作用是什麼呢?作爲緩存,cache的作用具體體現在讀與寫兩個不同的方面:作爲寫,一般存儲陣列只要求數據寫到cache就算完成了寫操作,當寫cache的數據積累到一定程度,陣列才把數據刷到磁盤,可以實現批量的寫入。所以,陣列的寫是非常快速的。至於cache數據的保護,一般都依賴於鏡相與電池(或者是UPS)。

cache在讀數據方面的作用一樣不可忽視,因爲如果所需要讀取的數據能在cache中命中的話,將大大減少磁盤尋道所需要的時間。因爲磁盤從開始尋道到找到數據,一般都在6ms以上,而這個時間,對於那些密集型I/O的應用可能不是太理想。但是,如果能在cache保存的數據中命中,一般響應時間則可以縮短在1ms以內。

不要迷信存儲廠商的IOPS(每秒的io數)數據,他們可能全部在cache命中的基礎上做到的,但是實際上,你的cache命中率可能只有10%。

介紹完cache,我們就可以解釋RAID5與RAID10在不同的模式下,工作效率問題了,那麼我們來分別分析讀操作、連續寫和離散寫三方面的問題。

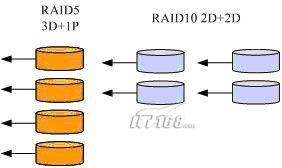

讀操作方面的性能差異

如我上文的介紹,磁盤陣列讀操作的關鍵更多的體現在cache的命中率上。所以,RAID5和RAID10在讀數據上面,他們基本是沒有差別的,除非是讀的數據能影響cache命中率,導致命中率不一樣。

連續寫方面的性能差異

連續寫的過程,一般表示寫入連續的大批量的數據,如媒體數據流,很大的文件等等。連續寫操作大多數產生於醫療PACS系統、高教圖書館系統、視頻編輯系統等等應用環境下。

根據我本人的經驗,在連續寫操作過程,如果有寫cache存在,並且算法沒有問題的話,RAID5比RAID10甚至會更好一些,雖然也許並沒有太大的差別。(這裏要假定存儲有一定大小足夠的寫cache,而且計算校驗的cpu不會出現瓶頸)。

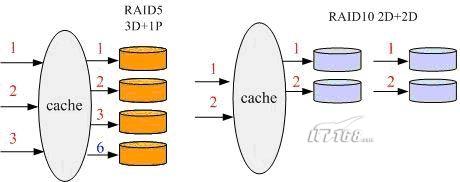

因爲這個時候的RAID校驗是在cache中完成,如4塊盤的RAID5,可以先在內存中計算好校驗,同時寫入3個數據+1個校驗。而RAID10只能同時寫入2個數據+2個鏡相。

如上圖所示,4塊盤的RAID5可以在同時間寫入1、2、3到cache,並且在cache計算好校驗之後,我這裏假定是6(實際的校驗計算並不是這樣的,我這裏僅僅是假設),同時把三個數據寫到磁盤。而4塊盤的RAID10不管cache是否存在,寫的時候,都是同時寫2個數據與2個鏡相。

根據我前面對緩存原理的介紹,寫cache是可以緩存寫操作的,等到緩存寫數據積累到一定時期再寫到磁盤。但是,寫到磁盤陣列的過程是遲早也要發生的,所以RAID5與RAID10在連續寫的情況下,從緩存到磁盤的寫操作速度會有較小的區別。不過,如果不是連續性的強連續寫,只要不達到磁盤的寫極限,差別並不是太大。

離散寫方面的性能差異

這裏可能會較難理解,但是,這一部分也是最重要的部分。企業中的絕大部分數據庫應用,如ERP系統等等在數據寫入的時候其實都是離散寫。

例如oracle 數據庫每次寫一個數據塊的數據,如8K;由於每次寫入的量不是很大,而且寫入的次數非常頻繁,因此聯機日誌看起來會像是連續寫。但是因爲不保證能夠添滿RAID5的一個條帶(保證每張盤都能寫入),所以很多時候更加偏向於離散寫入。

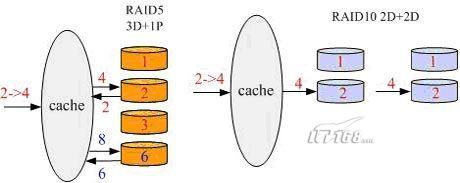

我們從上圖看一下離散寫的時候,RAID5與RAID10工作方式有什麼不同。如上圖:我們假定要把一個數字2變成數字4,那麼對於RAID5,實際發生了4次io:

先讀出2與校驗6,可能發生讀命中

然後在cache中計算新的校驗

寫入新的數字4與新的校驗8

如上圖我們可以看到:對於RAID10,同樣的單個操作,最終RAID10只需要2個io,而RAID5需要4個io。

這裏我忽略了RAID5在那兩個讀操作的時候,可能會發生讀命中操作的情況。也就是說,如果需要讀取的數據已經在cache中,可能是不需要4個io的。這也證明了cache對RAID5 的重要性,不僅僅是計算校驗需要,而且對性能的提升尤爲重要。我本人曾經測試過,在RAID5的陣列中,如果關閉寫cache,RAID5的性能將差很多倍。

當然,我並不是說cache對RAID10就不重要了,因爲寫緩衝,讀命中等,都是提高速度的關鍵所在,不過的是,RAID10對cache的依賴性沒有RAID5那麼明顯而已。

到這裏,大家應當也大致明白了RAID5與RAID10的原理與差別了,一般來說,象小io的數據庫類型操作,建議採用RAID10,而大型文件存儲,數據倉庫,則從空間利用的角度,可以採用RAID5。

在本文下篇,我們將進一步分析影響磁盤性能的不同因素,並分析不同的RAID方案對磁盤系統的影響

陣列的瓶頸主要體現在2個方面,帶寬與IOPS(單位時間傳輸的數據量,和單位時間完成的I/O數)。

影響帶寬的主要因素

存儲系統的帶寬主要取決於陣列的構架,光纖通道的大小(我們今天討論的陣列一般都是光纖陣列, SCSI這樣的SSA陣列,暫時不在討論範圍之列)以及硬盤的個數。

所謂陣列構架影響存儲系統帶寬,指的是存儲系統內部架構會存在一些內部帶寬,類似於PC的系統總線,儘管陣列的構架因不同廠商不同型號的產品而各有不同,不過一般情況下,內部帶寬都設計的很充足,不會是瓶頸的所在。

光纖通道對帶寬的影響還是比較大的,例如數據倉庫環境中,對數據的流量要求很大,而一塊2Gb的光纖卡,所能支撐的最大流量應當是2GB/8=250Mb/s的實際流量,必須配備4塊光纖卡才能達到1Gb/s的實際流量,所以對於數據倉庫的環境來說,升級到光纖4Gb並非是廠商過於超前的產品更新,在大流量的數據環境下絕對有必要考慮更換4GB的光纖卡。

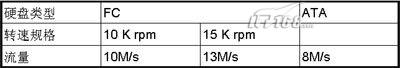

但是對於存儲系統的帶寬來說,硬盤接口的帶寬限制是最重要的。當前面的瓶頸不再存在的時候,帶寬就完全取決於硬盤的個數了,我下面列一下不同規格的硬盤所能支撐的流量大小,數據取自硬盤廠商的標準參數:

如果我們假定一個陣列有120塊15K rpm轉速的光纖硬盤,那麼硬盤上最大的可以支撐的數據流量爲120*13=1560Mb/s,當前端接口不成爲瓶頸的時候,1560Mb/s就是理論上的最大數據流量。

而如果要實現上述的最大帶寬,如果前端採用2GB的光纖卡,可能需要配置6塊才能夠,而4GB的光纖卡,配置3-4塊就夠了。因此我們可以知道,前端的光纖接口必須與後端磁盤個數相匹配。

但是否考慮到這些因素就足夠了呢,存儲系統的整體性能還受到多方面因素的影響,下面我們將分析存儲系統的另外一個重要的性能指標:IOPS。

影響IOPS的主要因素

我們前面已經說過了,廠商所提供的IOPS值是在理想狀態下測試出來的,對實際的運行性能的參考並不大,所以我們有必要通過以下幾個方面來衡量該系統的實際IOPS的可能表現。

決定IOPS的主要因素取決於陣列的算法,cache命中率,以及磁盤個數。

陣列的算法也因爲不同廠商不同型號的產品而不同,如我們最近遇到在HDS USP上面,可能因爲ldev(lun)存在隊列或者資源限制,而單個ldev的IOPS就上不去。所以,決定採購某型號的存儲之前,有必要了解這個存儲的一些算法規則與限制。

cache命中率對實際IOPS有決定性的影響,Cache命中率取決於數據的分佈,cache size的大小,數據訪問的規則,以及cache的算法,如果完整的討論下來,這裏將變得很複雜,可以有一天來慢慢討論。

我們這裏把這些內部原理都省略掉,只強調:對於一個存儲陣列來說,讀cache的命中率越高,一般就表示它可以支持更多的IOPS,爲什麼這麼說呢?這個就與我們下面要討論的硬盤IOPS有關係了。

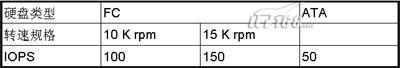

每個物理硬盤能處理的IOPS是有限制的,如

同樣,如果一個陣列有120塊15K rpm轉速的光纖硬盤,那麼,它能支撐的最大IOPS爲120*150=18000,這個爲硬件限制的理論值,如果超過這個值,硬盤的響應可能會變的非常緩慢而不能正常提供業務。較高的讀cache命中率,能降低硬盤的IOPS負荷,讓硬盤在較小的壓力下良好工作。

不同RAID對IOPS性能的影響

在我們的上一篇文章“RAID5和RAID10,哪種RAID適合你(上)”中曾經討論過,在RAID5與RAID10的不同機制上,讀數據時,IOPS性能其實沒有差別。但是,相同的業務,在寫入數據時,採用不同的RAID機制最終落在磁盤上的IOPS是有差別的,我們評估的正是磁盤的整體IOPS,如果達到了磁盤的限制,性能肯定是上不去了。

那我們假定一個case,業務應用的IOPS是10000,讀cache命中率是30%,讀IOPS爲60%,寫IOPS爲40%,磁盤個數爲120,那麼分別計算在RAID5與RAID10的情況下,每個磁盤的IOPS爲多少。

RAID5:

1. 單塊盤的IOPS = (10000*(1-0.3)*0.6 + 4 * (10000*0.4))/120

2. = (4200 + 16000)/120

3. = 168

這裏的10000*(1-0.3)*0.6表示是讀的IOPS,比例是0.6,除掉cache命中,實際只有4200個讀IOPS。

而4 * (10000*0.4) 表示寫的IOPS,因爲每一個寫,在RAID5中,實際發生了4個io,所以寫的IOPS爲16000個。

爲了考慮RAID5在寫操作的時候,那2個讀操作也可能發生命中,所以更精確的計算應該爲:

1. 單塊盤的IOPS = (10000*(1-0.3)*0.6 + 2 * (10000*0.4)*(1-0.3) + 2 * (10000*0.4))/120

2. = (4200 + 5600 + 8000)/120

3. = 148

這樣我們計算出來單個盤的IOPS爲148個,基本達到磁盤IOPS極限,在這種情況下,磁盤的工作狀態是非常不理想的。

RAID10對IOPS性能的影響

1. 單塊盤的IOPS = (10000*(1-0.3)*0.6 + 2 * (10000*0.4))/120

2. = (4200 + 8000)/120

3. = 102

可以看到,因爲RAID10對於一個寫操作,只發生2次io,所以,同樣的壓力,同樣的磁盤,每個盤的IOPS只有102個,還遠遠低於磁盤的極限IOPS。

這裏回到我們先前討論的case上來,在我們先前採用RAID5的時候,通過分析,每個磁盤的IOPS在高峯時期,快達到200了,導致響應速度巨慢無比。改造成RAID10,每個磁盤的IOPS降到100左右,很好的避免了這個性能問題。

影響讀數據的關鍵因素是cache命中率,在讀數據的情況下,RAID5與RAID10性能本身沒有太大差別。但是對於寫數據的一些應用,尤其是小I/O頻繁寫入的一些應用,如企業ERP生產系統等等,RAID10相比RAID5可能產生較大的性能差異。而大型文件存儲,數據倉庫,如醫療PACS系統、視頻編輯系統則從空間利用的角度,建議採用RAID5。

原文轉自:http://blog.csdn.net/yuan22003/article/details/6716402