功能實現

爬取所有銀行的銀行名稱和官網地址(如果沒有官網就忽略),並寫入數據庫;

銀行鏈接: http://www.cbrc.gov.cn/chinese/jrjg/index.html

編程思路

1.利用url訪問頁面並獲取頁面信息

2.利用正則表達式對頁面信息進行篩選,獲取我們需要的信息

3.保存至Mysql數據庫中

1.獲取網頁信息並保存至文件

from urllib.request import urlopen

# 獲取頁面信息

def getPageInfo(url):

pageInfo = urlopen(url)

content = pageInfo.read().decode('utf-8')

return content

# 主函數

def main():

url = 'http://www.cbrc.gov.cn/chinese/jrjg/index.html'

pageInfo = getPageInfo(url)

print(pageInfo)

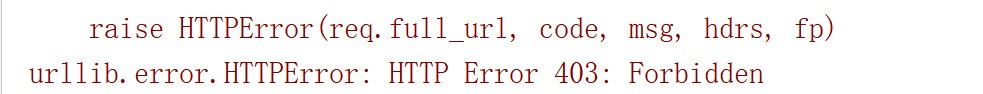

![Python練習【爬取銀行網站信息】]()

- 一些網站常常通過判斷 UA(User-Agent用戶代理) 來給不同的操作系統、不同的瀏覽器發送不同的頁面,因此可能造成某些頁面無法在某個瀏覽器中正常顯示,但通過僞裝 UA 可以繞過檢測。

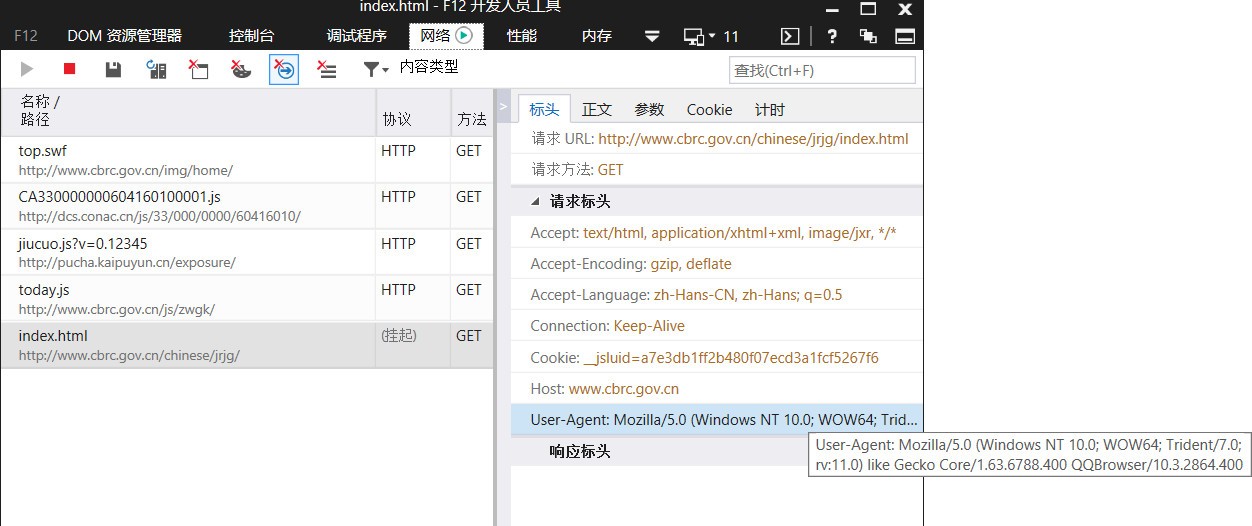

查看瀏覽器UA

![Python練習【爬取銀行網站信息】]()

獲取頁面信息

def main():

url = 'http://www.cbrc.gov.cn/chinese/jrjg/index.html'

#修改UA,僞裝成瀏覽器,以獲取相應頁面

user_agent = "Mozilla/5.0 (Windows NT 10.0; WOW64; Trident/7.0; rv:11.0) like Gecko Core/1.63.6788.400 QQBrowser/10.3.2864.400"

reqObj = request.Request(url, headers={'User-Agent': user_agent})

pageInfo = getPageInfo(reqObj)

print(pageInfo)

保存到文件方便查看

# 保存到文件pageContent

def saveInfo(data):

with open('doc/pageContent','w+',encoding='utf-8') as f:

f.write(data)

2.利用正則篩選所需信息

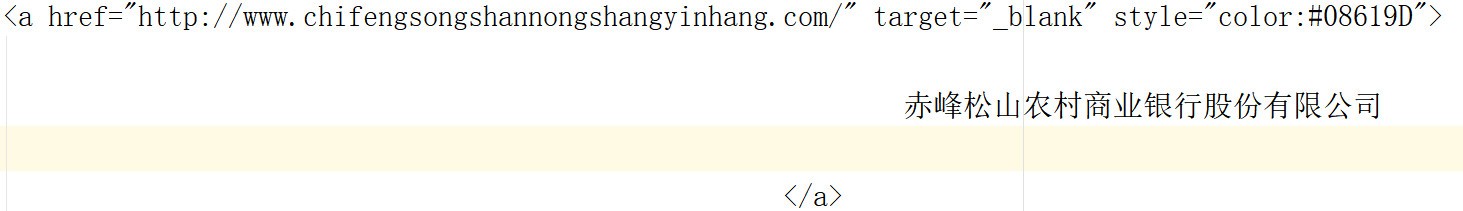

![Python練習【爬取銀行網站信息】]()

圖中是獲取的頁面信息中所需信息中的一例

需要獲取其中的 網址 和 銀行名稱

使用的正則表達式爲'<a href="(http.*?)".*?>\s+(.+?)\s+?</a>'

這裏注意利用\s+匹配額外的\t和\n

# 利用正則匹配獲取信息

def getInfo(data):

pattern = r'<a href="(http.*?)".*?>\s+(.+?)\s+?</a>'

info = re.findall(pattern ,data)

print(info)

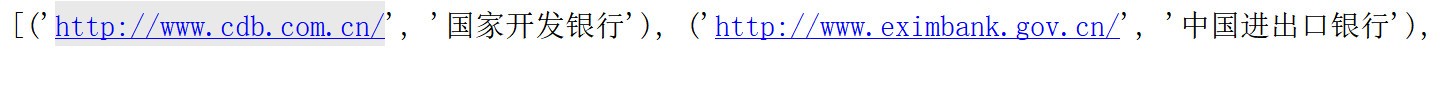

匹配到的信息:

![Python練習【爬取銀行網站信息】]()

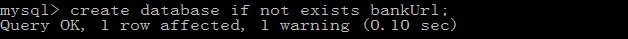

3.保存數據至數據庫

首先在mysql中創建一個名爲bankUrl的數據庫

![Python練習【爬取銀行網站信息】]()

連接數據庫

## 連接數據庫

conn = pymysql.connect(

host='localhost', # 主機名

user='root', # 用戶名

password='mysql', # 密碼

database='bankUrl', # 連接對應數據庫

charset='utf8', # utf-8編碼

autocommit=True # 自動提交數據

)

cur = conn.cursor() # 創建遊標

# 刪除重建表格來刷新每次寫入的數據

cur.execute('drop table bankurl')

creatTableSql = 'create table if not exists bankUrl(銀行名稱 varchar(20),網址 varchar(100))default charset=utf8;'

cur.execute(creatTableSql)

# 寫入數據庫

for item in getInfo(pageInfo):

insertSql = 'insert into bankUrl(銀行名稱,網址) value("{1}","{0}")'.format(item[0],item[1])

cur.execute(insertSql)

完整代碼:

import re

import time

from urllib import request

from urllib.request import urlopen

import pymysql

def timeCounter(fun):

def wrapper(*arg ,**kwargs):

startTime = time.time()

fun(*arg,**kwargs)

endTime = time.time()

print(fun.__name__+'運行時間爲%.2f'%(startTime-endTime))

return wrapper

# 獲取頁面信息

def getPageInfo(url):

pageInfo = urlopen(url)

content = pageInfo.read().decode('utf-8')

return content

# 保存頁面信息到文件

def saveInfo(data):

with open('doc/pageContent','w+',encoding='utf-8') as f:

f.write(data)

# 利用正則匹配獲取信息

def getInfo(data):

pattern = r'<a href="(http.*?)".*?>\s+(.+?)\s+?</a>'

info = re.findall(pattern ,data)

return info

@timeCounter

def main():

url = 'http://www.cbrc.gov.cn/chinese/jrjg/index.html'

user_agent = "Mozilla/5.0 (Windows NT 10.0; WOW64; Trident/7.0; rv:11.0) like Gecko Core/1.63.6788.400 QQBrowser/10.3.2864.400"

reqObj = request.Request(url, headers={'User-Agent': user_agent})

pageInfo = getPageInfo(reqObj)

# saveInfo(pageInfo)

conn = pymysql.connect(

host='localhost',

user='root',

password='mysql',

database='bankUrl',

charset='utf8',

autocommit=True, # 如果插入數據,, 是否自動提交? 和conn.commit()功能一致。

)

cur = conn.cursor()

# cur.execute('create database if not exists bankUrl;')

cur.execute('drop table bankurl')

creatTableSql = 'create table if not exists bankUrl(銀行名稱 varchar(20),網址 varchar(100))default charset=utf8;'

cur.execute(creatTableSql)

for item in getInfo(pageInfo):

insertSql = 'insert into bankUrl(銀行名稱,網址) value("{1}","{0}")'.format(item[0],item[1])

cur.execute(insertSql)

if __name__ == '__main__':

main()

查詢結果

![Python練習【爬取銀行網站信息】]()