深入理解一個技術的工作機制是靈活運用和快速解決問題的根本方法,也是唯一途徑。對於HDFS來說除了要明白它的應用場景和用法以及通用分佈式架構之外更重要的是理解關鍵步驟的原理和實現細節。在看這篇博文之前需要對HDFS以及分佈式系統有一些瞭解。請參考這篇博客。本篇博文首先對HDFS的重要特性和使用場景做一個簡要說明,之後對HDFS的數據讀寫、元數據管理以及NameNode、SecondaryNamenode的工作機制進行深入分析。過程中也會對一些配置參數做一個說明。

一.HDFS的重要特性

First. HDFS是一個文件系統,用於存儲和管理文件,通過統一的命名空間(類似於本地文件系統的目錄樹)。是分佈式的,服務器集羣中各個節點都有自己的角色和職責。

Then.

1.HDFS中的文件在物理上是分塊存儲(block),塊的大小可以通過配置參數( dfs.blocksize)來規定,默認大小在hadoop2.x版本中是128M,之前的版本中是64M。

2.HDFS文件系統會給客戶端提供一個統一的抽象目錄樹,客戶端通過路徑來訪問文件,形如:hdfs://namenode:port/dir-a/dir-b/dir-c/file.data

3.目錄結構及文件分塊位置信息(元數據)的管理由namenode節點承擔,namenode是HDFS集羣主節點,英國留學一年費用負責維護整個hdfs文件系統的目錄樹,以及每一個路徑(文件)所對應的數據塊信息(blockid及所在的datanode服務器)

4.文件的各個block的存儲管理由datanode節點承擔,datanode是HDFS集羣從節點,每一個block都可以在多個datanode上存儲多個副本(副本數量也可以通過參數設置dfs.replication,默認是3)

5.Datanode會定期向Namenode彙報自身所保存的文件block信息,而namenode則會負責保持文件的副本數量,HDFS的內部工作機制對客戶端保持透明,客戶端請求訪問HDFS都是通過向namenode申請來進行。

6.HDFS是設計成適應一次寫入,多次讀出的場景,且不支持文件的修改。需要頻繁的RPC交互,寫入性能不好。

二.HDFS寫數據分析

1.概述

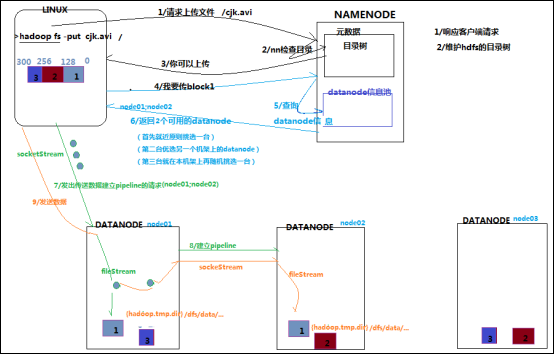

客戶端要向HDFS寫數據,首先要跟namenode通信以確認可以寫文件並獲得接收文件block的datanode,然後客戶端按順序將文件逐個block傳遞給相應datanode,並由接收到block的datanode負責向其他datanode複製block的副本。

2.寫數據步驟詳解

(圖片來自網絡,僅供參考)

1)客戶端向namenode發送上傳文件請求,namenode對要上傳目錄和文件進行檢查,判斷是否可以上傳,並向客戶端返回檢查結果。

2)客戶端得到上傳文件的允許後讀取客戶端配置,如果沒有指定配置則會讀取默認配置(例如副本數和塊大小默認爲3和128M,副本是由客戶端決定的)。向namenode請求上傳一個數據塊。

3)namenode會根據客戶端的配置來查詢datanode信息,如果使用默認配置,那麼最終結果會返回同一個機架的兩個datanode和另一個機架的datanode。這稱爲“機架感知”策略。

機架感知:HDFS採用一種稱爲機架感知(rack-aware)的策略來改進數據的可靠性、可用性和網絡帶寬的利用率。大型HDFS實例一般運行在跨越多個機架的計算機組成的集羣上,不同機架上的兩臺機器之間的通訊需要經過交換機。在大多數情況下,同一個機架內的兩臺機器間的帶寬會比不同機架的兩臺機器間的帶寬大。通過一個機架感知的過程,Namenode可以確定每個Datanode所屬的機架id。一個簡單但沒有優化的策略就是將副本存放在不同的機架上。這樣可以有效防止當整個機架失效時數據的丟失,並且允許讀數據的時候充分利用多個機架的帶寬。這種策略設置可以將副本均勻分佈在集羣中,有利於當組件失效情況下的負載均衡。但是,因爲這種策略的一個寫操作需要傳輸數據塊到多個機架,這增加了寫的代價。在大多數情況下,副本系數是3,HDFS的存放策略是將一個副本存放在本地機架的節點上,一個副本放在同一機架的另一個節點上,最後一個副本放在不同機架的節點上。這種策略減少了機架間的數據傳輸,這就提高了寫操作的效率。機架的錯誤遠遠比節點的錯誤少,所以這個策略不會影響到數據的可靠性和可用性。於此同時,因爲數據塊只放在兩個(不是三個)不同的機架上,所以此策略減少了讀取數據時需要的網絡傳輸總帶寬。在這種策略下,副本並不是均勻分佈在不同的機架上。三分之一的副本在一個節點上,三分之二的副本在一個機架上,其他副本均勻分佈在剩下的機架中,這一策略在不損害數據可靠性和讀取性能的情況下改進了寫的性能。

4)客戶端在開始傳輸數據塊之前會把數據緩存在本地,當緩存大小超過了一個數據塊的大小,客戶端就會從namenode獲取要上傳的datanode列表。之後會在客戶端和第一個datanode建立連接開始流式的傳輸數據,這個datanode會一小部分一小部分(4K)的接收數據然後寫入本地倉庫,同時會把這些數據傳輸到第二個datanode,第二個datanode也同樣一小部分一小部分的接收數據並寫入本地倉庫,同時傳輸給第三個datanode,依次類推。這樣逐級調用和返回之後,待這個數據塊傳輸完成客戶端後告訴namenode數據塊傳輸完成,這時候namenode纔會更新元數據信息記錄操作日誌。

5)第一個數據塊傳輸完成後會使用同樣的方式傳輸下面的數據塊直到整個文件上傳完成。

細節:

a.請求和應答是使用RPC的方式,客戶端通過ClientProtocol與namenode通信,namenode和datanode之間使用DatanodeProtocol交互。在設計上,namenode不會主動發起RPC,而是響應來自客戶端或 datanode 的RPC請求。客戶端和datanode之間是使用socket進行數據傳輸,和namenode之間的交互採用nio封裝的RPC。

b.HDFS有自己的序列化協議。

c.在數據塊傳輸成功後但客戶端沒有告訴namenode之前如果namenode宕機那麼這個數據塊就會丟失。

d.在流式複製時,逐級傳輸和響應採用響應隊列來等待傳輸結果。隊列響應完成後返回給客戶端。

c.在流式複製時如果有一臺或兩臺(不是全部)沒有複製成功,不影響最後結果,只不過datanode會定期向namenode彙報自身信息。如果發現異常namenode會指揮datanode刪除殘餘數據和完善副本。如果副本數量少於某個最小值就會進入安全模式。

安全模式:Namenode啓動後會進入一個稱爲安全模式的特殊狀態。處於安全模式的Namenode是不會進行數據塊的複製的。Namenode從所有的 Datanode接收心跳信號和塊狀態報告。塊狀態報告包括了某個Datanode所有的數據塊列表。每個數據塊都有一個指定的最小副本數。當Namenode檢測確認某個數據塊的副本數目達到這個最小值,那麼該數據塊就會被認爲是副本安全(safely replicated)的;在一定百分比(這個參數可配置)的數據塊被Namenode檢測確認是安全之後(加上一個額外的30秒等待時間),Namenode將退出安全模式狀態。接下來它會確定還有哪些數據塊的副本沒有達到指定數目,並將這些數據塊複製到其他Datanode上。

三.HDFS讀數據分析

1.概述

客戶端將要讀取的文件路徑發送給namenode,namenode獲取文件的元信息(主要是block的存放位置信息)返回給客戶端,客戶端根據返回的信息找到相應datanode逐個獲取文件的block並在客戶端本地進行數據追加合併從而獲得整個文件。

2.讀數據步驟詳解

(圖片來源於網絡,僅供參考)

1)客戶端向namenode發起RPC調用,請求讀取文件數據。

2)namenode檢查文件是否存在,如果存在則獲取文件的元信息(blockid以及對應的datanode列表)。

3)客戶端收到元信息後選取一個網絡距離最近的datanode,依次請求讀取每個數據塊。客戶端首先要校檢文件是否損壞,如果損壞,客戶端會選取另外的datanode請求。

4)datanode與客戶端簡歷socket連接,傳輸對應的數據塊,客戶端收到數據緩存到本地,之後寫入文件。

5)依次傳輸剩下的數據塊,直到整個文件合併完成。

從某個Datanode獲取的數據塊有可能是損壞的,損壞可能是由Datanode的存儲設備錯誤、網絡錯誤或者軟件bug造成的。HDFS客戶端軟件實現了對HDFS文件內容的校驗和(checksum)檢查。當客戶端創建一個新的HDFS文件,會計算這個文件每個數據塊的校驗和,並將校驗和作爲一個單獨的隱藏文件保存在同一個HDFS名字空間下。當客戶端獲取文件內容後,它會檢驗從Datanode獲取的數據跟相應的校驗和文件中的校驗和是否匹配,如果不匹配,客戶端可以選擇從其他Datanode獲取該數據塊的副本。

四.HDFS刪除數據分析

HDFS刪除數據比較流程相對簡單,只列出詳細步驟:

1)客戶端向namenode發起RPC調用,請求刪除文件。namenode檢查合法性。

2)namenode查詢文件相關元信息,向存儲文件數據塊的datanode發出刪除請求。

3)datanode刪除相關數據塊。返回結果。

4)namenode返回結果給客戶端。

當用戶或應用程序刪除某個文件時,這個文件並沒有立刻從HDFS中刪除。實際上,HDFS會將這個文件重命名轉移到/trash目錄。只要文件還在/trash目錄中,該文件就可以被迅速地恢復。文件在/trash中保存的時間是可配置的,當超過這個時間時,Namenode就會將該文件從名字空間中刪除。刪除文件會使得該文件相關的數據塊被釋放。注意,從用戶刪除文件到HDFS空閒空間的增加之間會有一定時間的延遲。只要被刪除的文件還在/trash目錄中,用戶就可以恢復這個文件。如果用戶想恢復被刪除的文件,他/她可以瀏覽/trash目錄找回該文件。/trash目錄僅僅保存被刪除文件的最後副本。/trash目錄與其他的目錄沒有什麼區別,除了一點:在該目錄上HDFS會應用一個特殊策略來自動刪除文件。目前的默認策略是刪除/trash中保留時間超過6小時的文件。將來,這個策略可以通過一個被良好定義的接口配置。

當一個文件的副本系數被減小後,Namenode會選擇過剩的副本刪除。下次心跳檢測時會將該信息傳遞給Datanode。Datanode遂即移除相應的數據塊,集羣中的空閒空間加大。同樣,在調用setReplication API結束和集羣中空閒空間增加間會有一定的延遲。

五.NameNode元數據管理原理分析

1.概述

首先明確namenode的職責:響應客戶端請求、管理元數據。

namenode對元數據有三種存儲方式:

內存元數據(NameSystem)

磁盤元數據鏡像文件

數據操作日誌文件(可通過日誌運算出元數據)

細節:HDFS不適合存儲小文件的原因,每個文件都會產生元信息,當小文件多了之後元信息也就多了,對namenode會造成壓力。

2.對三種存儲機制的進一步解釋

內存元數據就是當前namenode正在使用的元數據,是存儲在內存中的。

磁盤元數據鏡像文件是內存元數據的鏡像,保存在namenode工作目錄中,它是一個準元數據,作用是在namenode宕機時能夠快速較準確的恢復元數據。稱爲fsimage。

數據操作日誌文件是用來記錄元數據操作的,在每次改動元數據時都會追加日誌記錄,如果有完整的日誌就可以還原完整的元數據。主要作用是用來完善fsimage,減少fsimage和內存元數據的差距。稱爲editslog。

3.checkpoint機制分析

因爲namenode本身的任務就非常重要,爲了不再給namenode壓力,日誌合併到fsimage就引入了另一個角色secondarynamenode。secondarynamenode負責定期把editslog合併到fsimage,“定期”是namenode向secondarynamenode發送RPC請求的,是按時間或者日誌記錄條數爲“間隔”的,這樣即不會浪費合併操作又不會造成fsimage和內存元數據有很大的差距。因爲元數據的改變頻率是不固定的。

每隔一段時間,會由secondary namenode將namenode上積累的所有edits和一個最新的fsimage下載到本地,託福官網並加載到內存進行merge(這個過程稱爲checkpoint)。

(圖片來源於網絡,僅供參考)

1)namenode向secondarynamenode發送RPC請求,請求合併editslog到fsimage。

2)secondarynamenode收到請求後從namenode上讀取(通過http服務)editslog(多個,滾動日誌文件)和fsimage文件。

3)secondarynamenode會根據拿到的editslog合併到fsimage。形成最新的fsimage文件。(中間有很多步驟,把文件加載到內存,還原成元數據結構,合併,再生成文件,新生成的文件名爲fsimage.checkpoint)。

4)secondarynamenode通過http服務把fsimage.checkpoint文件上傳到namenode,並且通過RPC調用把文件改名爲fsimage。

namenode和secondary namenode的工作目錄存儲結構完全相同,所以,當namenode故障退出需要重新恢復時,可以從secondary namenode的工作目錄中將fsimage拷貝到namenode的工作目錄,以恢復namenode的元數據。

關於checkpoint操作的配置:

dfs.namenode.checkpoint.check.period=60 #檢查觸發條件是否滿足的頻率,60秒

dfs.namenode.checkpoint.dir=file://${hadoop.tmp.dir}/dfs/namesecondary

#以上兩個參數做checkpoint操作時,secondary namenode的本地工作目錄

dfs.namenode.checkpoint.edits.dir=${dfs.namenode.checkpoint.dir}

dfs.namenode.checkpoint.max-retries=3 #最大重試次數

dfs.namenode.checkpoint.period=3600 #兩次checkpoint之間的時間間隔3600秒

dfs.namenode.checkpoint.txns=1000000 #兩次checkpoint之間最大的操作記錄

editslog和fsimage文件存儲在$dfs.namenode.name.dir/current目錄下,這個目錄可以在hdfs-site.xml中配置的。這個目錄下的文件結構如下:

包括edits日誌文件(滾動的多個文件),有一個是edits_inprogress_*是當前正在寫的日誌。fsimage文件以及md5校檢文件。seen_txid是記錄當前滾動序號,代表seen_txid之前的日誌都已經合併完成。

$dfs.namenode.name.dir/current/seen_txid非常重要,是存放transactionId的文件,format之後是0,它代表的是namenode裏面的edits_*文件的尾數,namenode重啓的時候,會按照seen_txid的數字恢復。所以當你的hdfs發生異常重啓的時候,一定要比對seen_txid內的數字是不是你edits最後的尾數,不然會發生重啓namenode時metaData的資料有缺少,導致誤刪Datanode上多餘Block的信息。

六.總結

深入理解了以上介紹的工作機制就可以嘗試運用他們解決工作和學習中遇到的問題了,只要真正理解了核心原理,所有問題都可以自己找到答案。就是要不斷的學習、實踐、總結,再學習、再實踐、再總結。這樣才能紮紮實實做的出色。共勉。