基於 HanLP 的 Elasticsearch 中文分詞插件,核心功能:

兼容 ES 5.x-7.x;

內置詞典,無需額外配置即可使用;

支持用戶自定義詞典;

支持遠程詞典熱更新(待開發);

內置多種分詞模式,適合不同場景;

拼音過濾器(待開發);

簡繁體轉換過濾器(待開發)。

版本

插件版本和 ES 版本一致,直接下載對應版本的插件進行安裝即可。

·插件開發完成時,最新版本已經爲 6.5.2 了,所以個人只對典型的版本進行了測試;

·5.X 在 5.0.0、5.5.0 版本進行了測試;

·6.X 在 6.0.0、6.3.0、6.4.1、6.5.1 版本進行了測試;

·7.X 在 7.0.0 版本進行了測試。

安裝使用

下載編譯

git clone 對應版本的代碼,打開 pom.xml 文件,修改 <elasticsearch.version>6.5.1</elasticsearch.version> 爲需要的 ES 版本;然後使用 mvn package 生產打包文件,最終文件在 target/release 文件夾下。

打包完成後,使用離線方式安裝即可。

使用默認詞典

·在線安裝:.\elasticsearch-plugin install https://github.com/AnyListen/elasticsearch-analysis-hanlp/releases/download/vA.B.C/elasticsearch-analysis-hanlp-A.B.C.zip

·離線安裝:.\elasticsearch-plugin install file:///FILE_PATH/elasticsearch-analysis-hanlp-A.B.C.zip

離線安裝請把 FILE_PATH 更改爲 zip 文件路徑;A、B、C 對應的是 ES 版本號。

使用自定義詞典

默認詞典是精簡版的詞典,能夠滿足基本需求,但是無法使用感知機和 CRF 等基於模型的分詞器。

HanLP 提供了更加完整的詞典,請按需下載。

詞典下載後,解壓到任意目錄,然後修改插件安裝目錄下的 hanlp.properties 文件,只需修改第一行

root=D:/JavaProjects/HanLP/

爲 data 的父目錄即可,比如 data 目錄是 /Users/hankcs/Documents/data,那麼 root=/Users/hankcs/Documents/。

使用自定義配置文件

如果你在其他地方使用了 HanLP,希望能夠複用 hanlp.properties 文件,你只需要修改插件安裝目錄下的 plugin.properties 文件,將 configPath 配置爲已有的 hanlp.properties 文件地址即可。

內置分詞器

分析器(Analysis)

·hanlp_index:細粒度切分

·hanlp_smart:常規切分

·hanlp_nlp:命名實體識別

·hanlp_per:感知機分詞

·hanlp_crf:CRF分詞

·hanlp:自定義

分詞器(Tokenizer)

·hanlp_index:細粒度切分

·hanlp_smart:常規切分

·hanlp_nlp:命名實體識別

·hanlp_per:感知機分詞

·hanlp_crf:CRF分詞

·hanlp:自定義

自定義分詞器

插件有較爲豐富的選項允許用戶自定義分詞器,下面是可用的配置項:

案例展示:

# 創建自定義分詞器

PUT my_index

{

"settings": {

"analysis": {

"analyzer": {

"my_analyzer": {

"type": "hanlp",

"algorithm": "viterbi",

"enableIndexMode": "true",

"enableCustomDictionary": "true",

"customDictionaryPath": "",

"enableCustomDictionaryForcing": "false",

"enableStopWord": "true",

"stopWordDictionaryPath": "",

"enableNumberQuantifierRecognize": "true",

"enableNameRecognize": "true",

"enableTranslatedNameRecognize": "true",

"enableJapaneseNameRecognize": "true",

"enableOrganizationRecognize": "true",

"enablePlaceRecognize": "true",

"enableTraditionalChineseMode": "false"

}

}

}

}

}

# 測試分詞器

POST my_index/_analyze

{

"analyzer": "my_analyzer",

"text": "張惠妹在上海市舉辦演唱會啦"

}

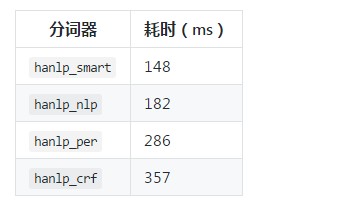

分詞速度(僅供參考)

藉助 _analyze API(1核1G單線程),通過改變分詞器類型,對 2W 字的文本進行分詞,以下爲從請求到返回的耗時: