論文閱讀:設計深度卷積神經網絡的實用技巧理論

綜述

網絡層數逐漸加深是大勢所趨,如何設計高效的更深的網絡是目前的問題,盲目的疊加層數並不能取得好的效果。

本文提出兩種全新視角的限制約束,使得網絡結構變深的同時保證效果。

- 第一:保證每一層卷積層都有學習複雜模式特徵的能力

- 第二:最高層的感受野不能大於圖片範圍

在這兩個限制條件下,我們把設計深度卷積神經網絡的問題轉化爲限制條件下的最優化問題

Approach

首先將CNN模型劃分爲classifier和feature兩層結構

本文的設計主要集中在feature level, classifier level設爲固定形式。

Feature level最優化問題:

- 限制一:每一層的c值不能太小(c值是度量網絡學習能力的一個指標)

- 限制二:卷積層最高層的感受野不能大於圖片大小

- 目標:在限制基礎上,儘可能的使網絡深

設定固定的classifier level:

受到Network in Network 和 GoogleNet的啓發,用兩層CNN代替以往常用的全連接層,較小的feature map配合較大的kernel size,並經過最大池化,作用類似全連接,實驗表明這樣的設計有更好的效果。

最優化問題

第一限制:學習能力

卷積層設計的目的就是爲了從其輸入模式中組合出更復雜的模式特徵。

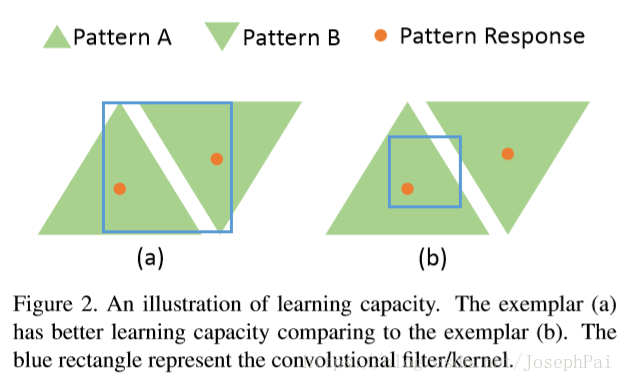

如圖,pattern A和pattern B作爲輸入,左邊的a可以組合新的模式AB,但是右邊的b無法做到這一點,也就是學習能力不足。

解決方式,一種是增大kernel size,另一種是下采樣down sampling

本文我們採取下采樣方式。

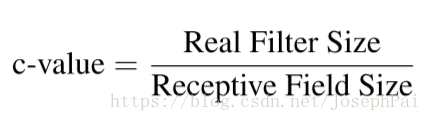

用c值定量描述卷積層的學習能力

分子real filter size就是kernel size,分母receptive field size是網絡模型在原始圖像中能“看到”的最大範圍尺寸。

通過實驗的經驗,得出卷積層的c值應該大於1/6(lower bound)第二限制

實驗得到Receptive field size達到image size後繼續增加網絡層數,會造成過擬合,從而降低準確率。

依舊是根據經驗得出限制:最高層Receptive field size(感受野大小)不能超過原始圖片尺寸。

當感受野較小時,我們可以增加網絡層數,否則它將無法組合學習更復雜的特徵,從而使得模型表現不佳。

Reference:

X Cao. A practical theory for designing very deep convolutional neural networks