1、刪除osd

刪除創建的osd。

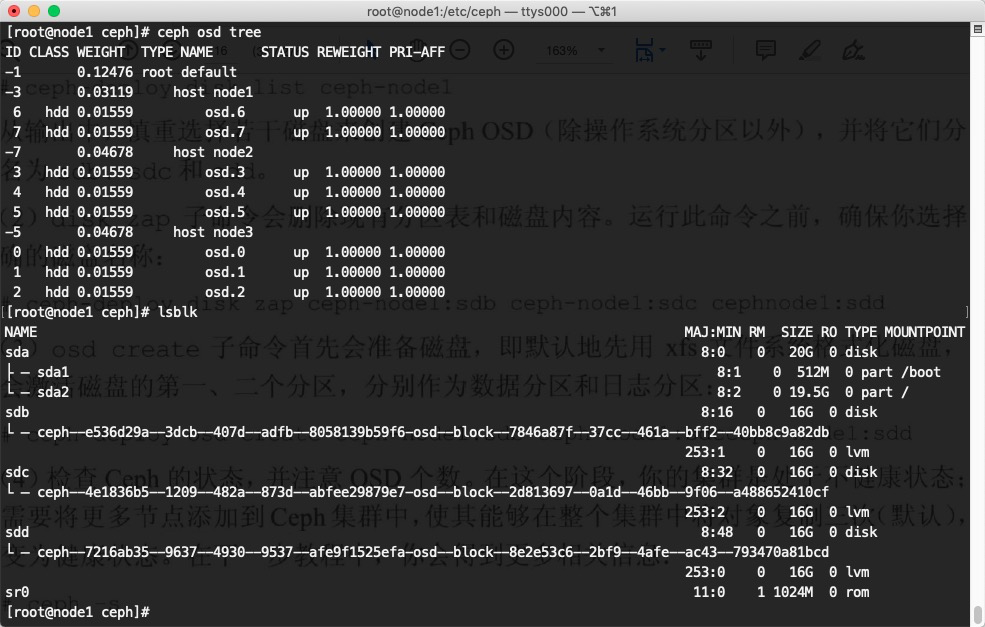

數據和日誌在同一個磁盤上的osd

將osd.0踢出集羣,執行ceph osd out 0

停止此osd進程,執行systemctl stop ceph-osd@0

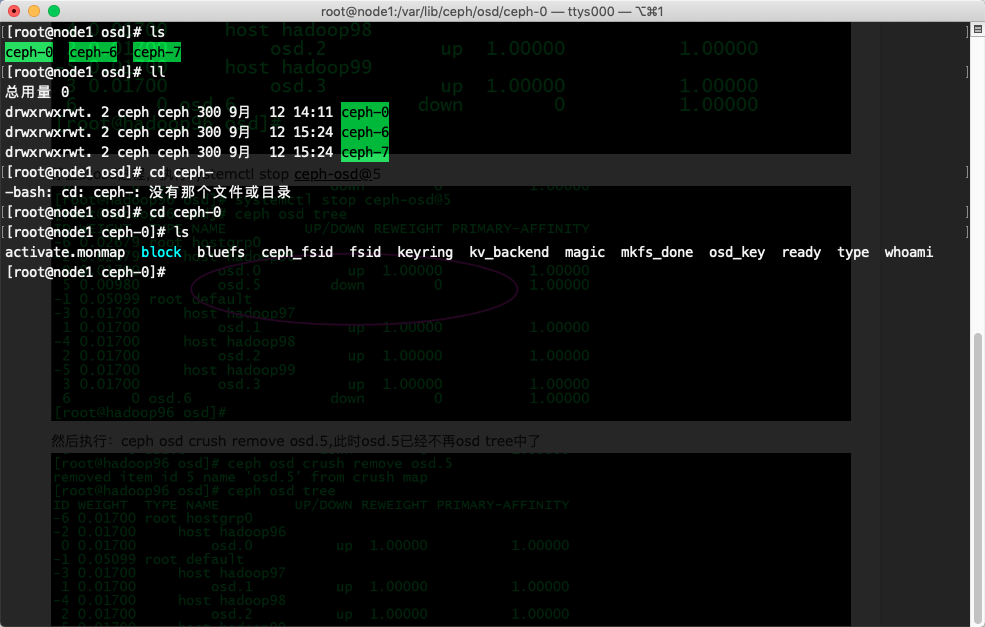

然後執行:ceph osd crush remove osd.0,此時osd.0已經不再osd tree中了

執行ceph auth del osd.0 和 ceph osd rm 0, 此時刪除成功但是原來的數據和日誌目錄還在,也就是數據還在

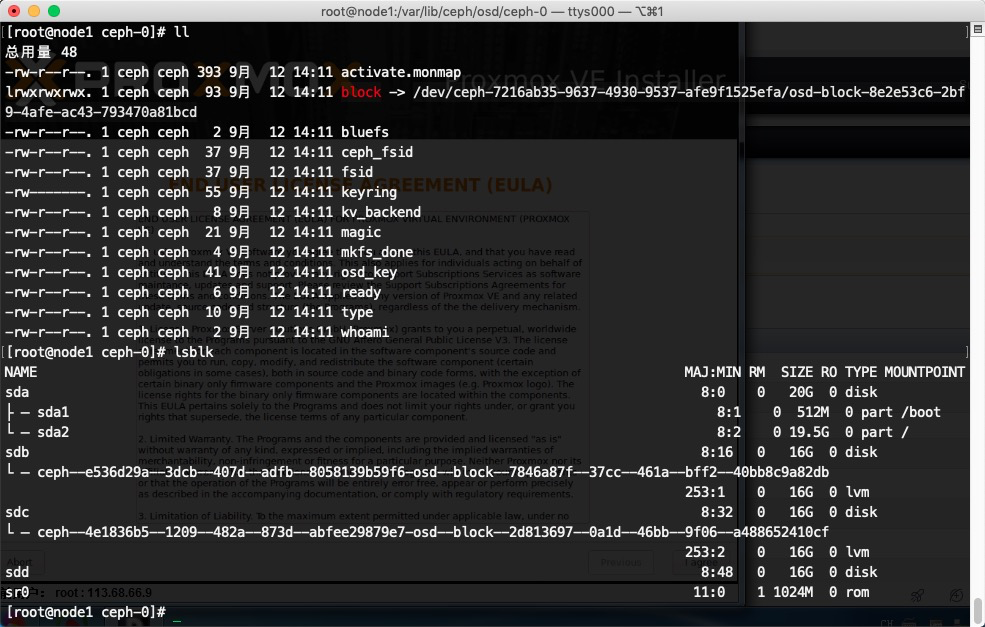

此時我們將/dev/sdd磁盤umount,然後將磁盤進行擦除那麼數據就會被完全刪除了,執行umount /dev/sdd,然後執行ceph-disk zap /dev/sdd

但是發現umount 不了,也無法刪除文件夾

方法

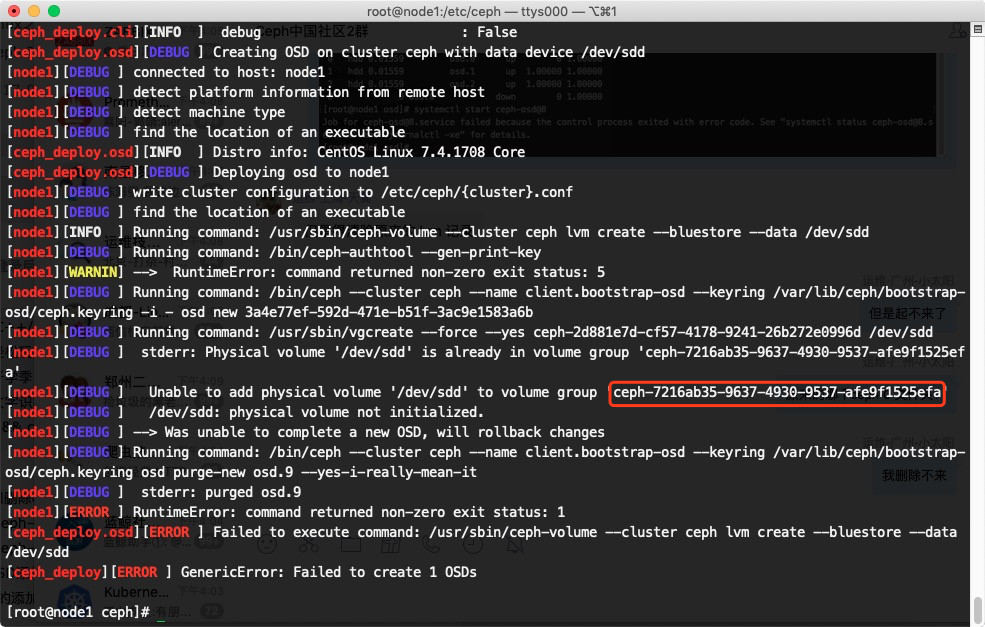

創建osd

ceph-deploy osd create --data /dev/sdd node1

因爲有原來的 lvm 記錄,所以重新創建不了,提示原來的lvm有記錄

記錄下 vg 序列號

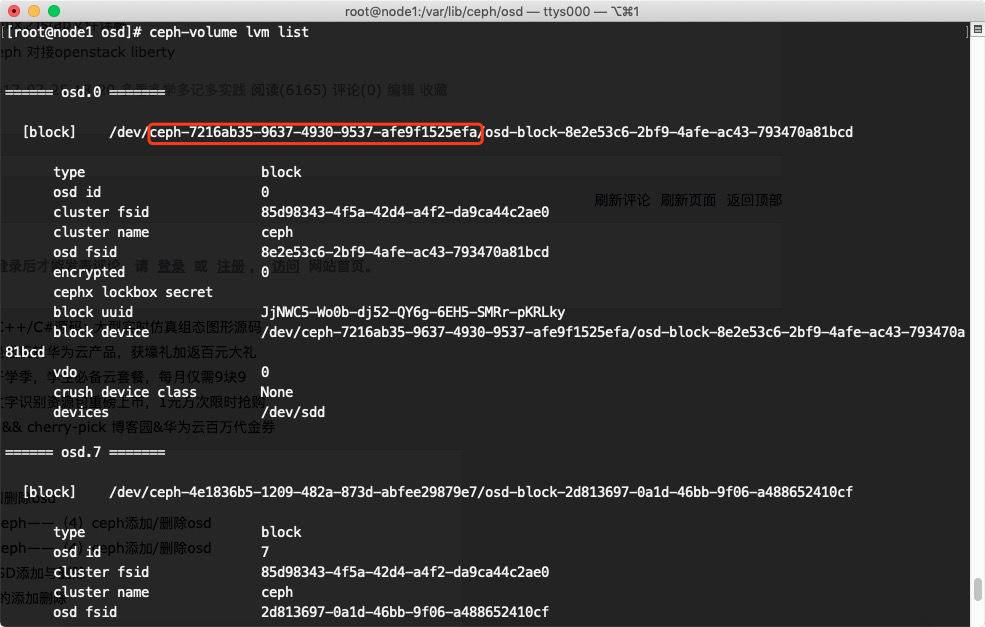

ceph-volume lvm list

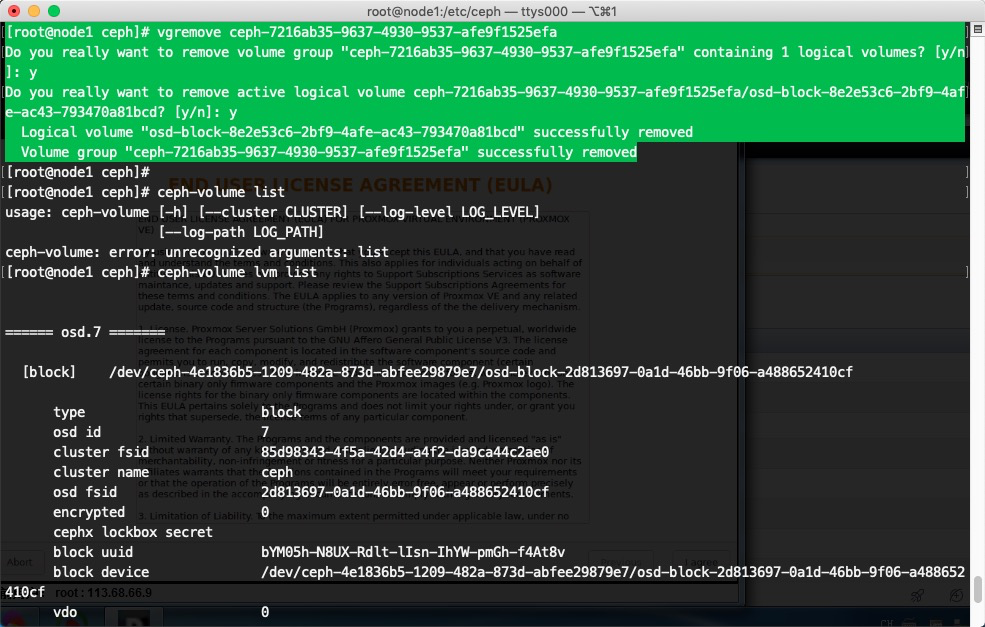

刪除vg記錄

vgremove ceph-7216ab35-9637-4930-9537-afe9f1525efa

此時sdd 出來了

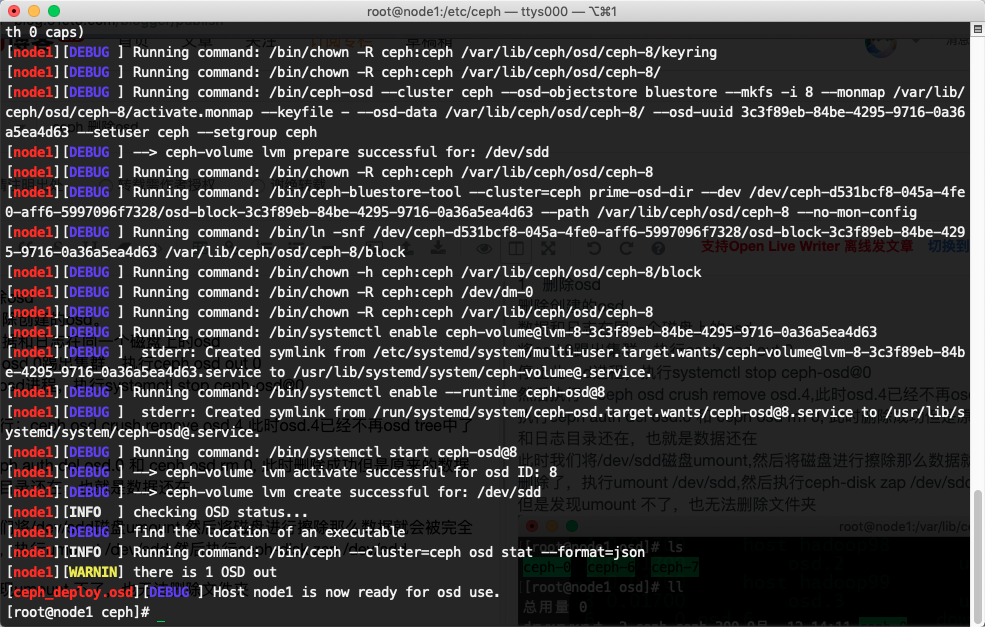

在次執行創建osd

ceph-deploy osd create --data /dev/sdd node1

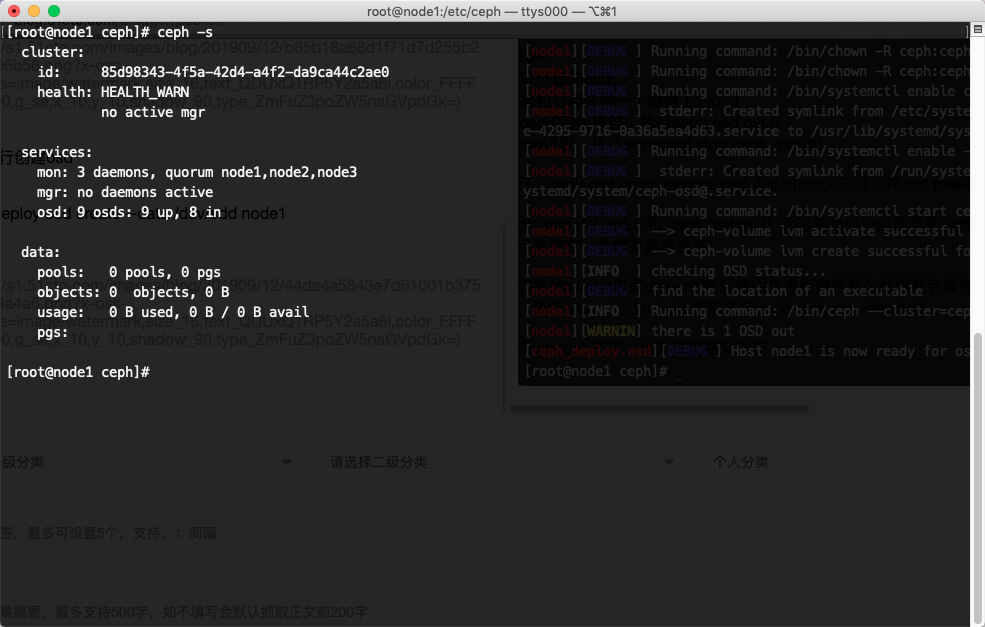

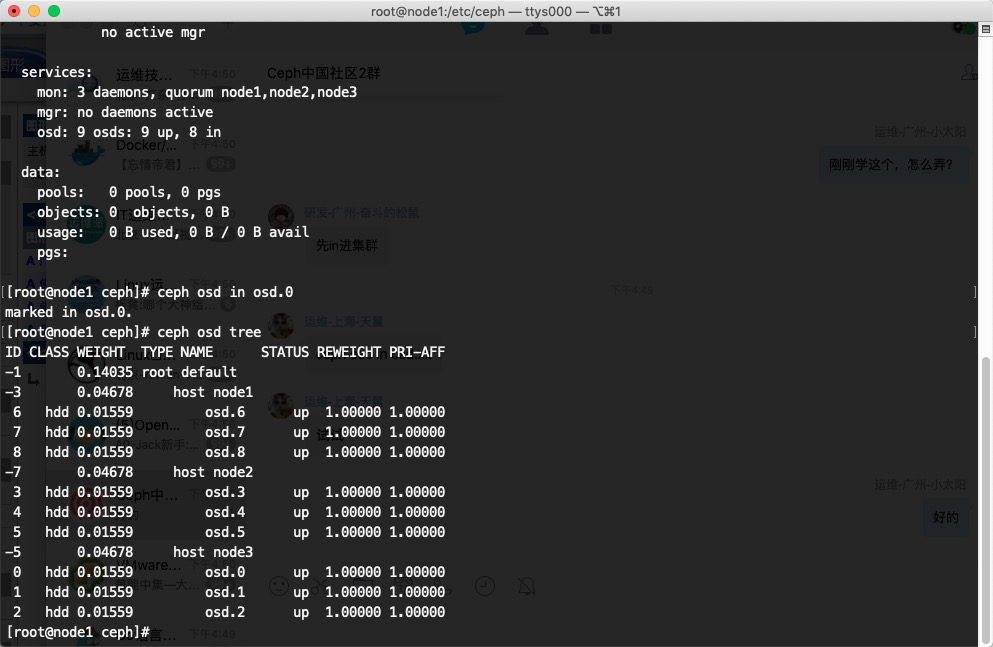

osd.0 in進集羣

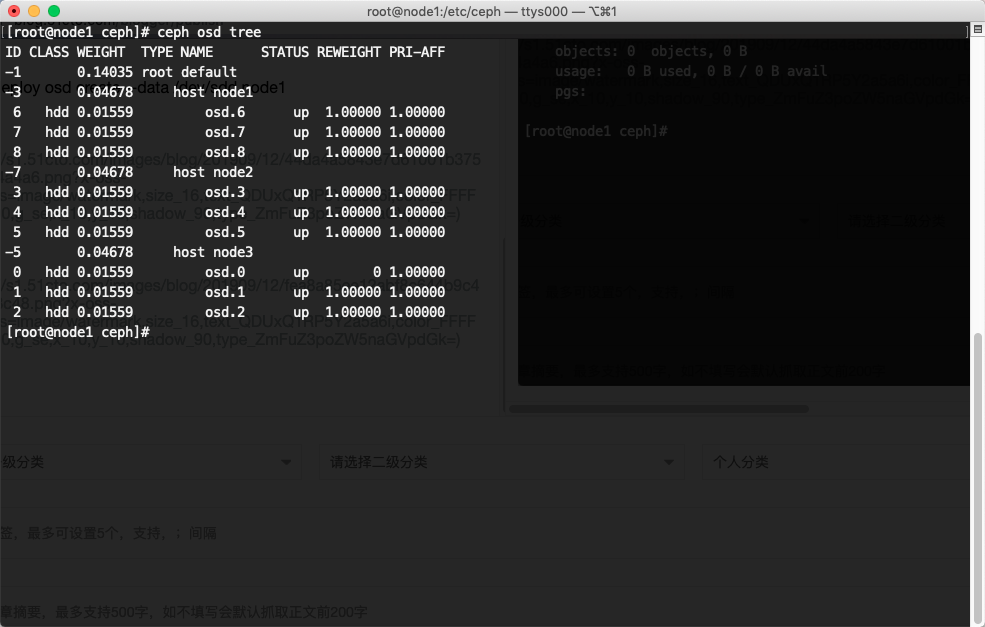

ceph osd in osd.0