1. Saver簡介

訓練完一個模型後,爲了以後重複使用,通常希望保存訓練的結果,這些結果指的是模型的參數,也就是神經網絡中的各項權重值。以便下次迭代的訓練或者用作測試。

Tensorflow針對這一需求提供了Saver類。 Saver類提供了向checkpoints文件保存和從checkpoints文件中恢復變量的相關方法。Checkpoints文件是一個二進制文件,它把變量名映射到對應的tensor值 。

爲了避免填滿整個磁盤,Saver可以自動的管理Checkpoints文件。例如,我們可以指定保存最近的N個Checkpoints文件。

2. Saver的應用

**2.1 訓練階段**

使用tf.train.Saver.save()方法保存模型

tf.train.Saver.save(sess, save_path, global_step=None, latest_filename=None, meta_graph_suffix='meta', write_meta_graph=True, write_state=True)

- sess: 表示當前會話,當前會話記錄了當前的變量值。

- save_path: String類型,用於指定訓練結果的保存路徑。

- global_step:表示當前是第幾步。如果提供的話,這個數字會添加到save_path後面,用於構建checkpoint文件。這個參數有助於我們區分不同訓練階段的結果。

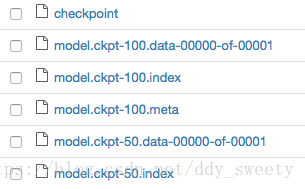

訓練完成後,當前目錄底下會多出5個文件。

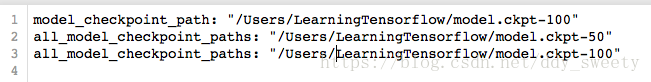

打開名爲“checkpoint”的文件,可以看到保存記錄,和最新的模型存儲位置。

**2.2 測試驗證階段**

使用tf.train.Saver.restore方法恢復模型及變量

tf.train.Saver.restore(sess, save_path)

- sess: 表示當前會話,之前保存的結果將被加載入這個會話

- save_path: 同保存模型是用到的的save_path參數。

運行結果如下圖所示,加載了之前訓練的參數w和b的結果

3.Saver實例

import tensorflow as tf

import numpy as np

x = tf.placeholder(tf.float32, shape=[None, 1])

y = 4 * x + 4

w = tf.Variable(tf.random_normal([1], -1, 1))

b = tf.Variable(tf.zeros([1]))

y_predict = w * x + b

loss = tf.reduce_mean(tf.square(y - y_predict))

optimizer = tf.train.GradientDescentOptimizer(0.5)

train = optimizer.minimize(loss)

#用於驗證

isTrain = False

#用於訓練

isTrain = True

train_steps = 100

checkpoint_steps = 50

checkpoint_dir = '/Users/LearningTensorflow/'

saver = tf.train.Saver() # defaults to saving all variables - in this case w and b

x_data = np.reshape(np.random.rand(10).astype(np.float32), (10, 1))

with tf.Session() as sess:

sess.run(tf.initialize_all_variables())

if isTrain:

for i in range(train_steps):

sess.run(train, feed_dict={x: x_data})

if (i + 1) % checkpoint_steps == 0:

saver.save(sess, checkpoint_dir + 'model.ckpt', global_step=i+1)

else:

ckpt = tf.train.get_checkpoint_state(checkpoint_dir)

if ckpt and ckpt.model_checkpoint_path:

saver.restore(sess, ckpt.model_checkpoint_path)

print(sess.run(w))

print(sess.run(b))

else:

pass

print(sess.run(w))

print(sess.run(b)) - isTrain:用來區分訓練階段和測試階段,True表示訓練,False表示測試

train_steps:表示訓練的次數,例子中使用100

checkpoint_steps:表示訓練多少次保存一下checkpoints,例子中使用50

checkpoint_dir:表示checkpoints文件的保存路徑,例子中使用當前路徑

訓練階段輸出結果

[3.8142192]

[4.1174507]

[3.972232]

[4.0175548]驗證階段輸出結果,加載了之前訓練的參數w和b的結果

[3.972232]

[4.0175548]