在講LVS之前先說一下集羣的概念

Cluster

集羣,爲解決某個特定問題將多臺計算機組合起來形成的單個系統。

同一個業務系統,部署在多臺服務器上。集羣中,每一臺服務器實現的功能沒有差別,數據和代碼都是一樣的。

Linux Cluster類型:

LB: Load Balancing,負載均衡

HA: High Availiablity,高可用, SPOF(single Point Of failure)

MTBF:Mean Time Between Failure 平均無故障時間

MTTR:Mean Time To Restoration(repair)平均恢復前時間

A=MTBF/(MTBF+MTTR) (0,1): 99%, 99.5%, 99.9%, 99.99%, 99.999%

HPC: High-performance computing,高性能

分佈式

一個業務被拆成多個子業務,或者本身就是不同的業務,部署在多臺服務器上。分佈式中,每一臺服務器實現的功能是有差別的,數據和代碼也是不一樣的,分佈式每臺服務器功能加起來,纔是完整的業務。

集羣與分佈式的區別

分佈式是以縮短單個任務的執行時間來提升效率的,而集羣則是通過提高單位時間內執行的任務數來提升效率。

LB Cluster的實現

硬件

- F5 Big-IP

- Citrix Netscaler

- A10 A10

軟件

- lvs: Linux Virtual Server(工作在四層及傳輸層基於內核實現,性能強大功能簡單,單負載上/數百萬連接)

- nginx:支持七層調度, 阿里七層SLB使用Tengine(單服務器單IP 65536/2連接)

- haproxy:七層調度,支持模擬四層,四層工作於內核, haproxy及nginx是應用程序

- ats: apache traffic server, yahoo捐助

- perlbal: Perl 編寫

- pound

關於LVS

LVS,Linux Virtual Server即“Linux虛擬服務器”。

通過LVS可以實現負載均衡集羣方案,它是一個針對Linux內核開發的一個負載均衡項目。基於IP地址和內容請求分發的高效的負載均衡解決方法,現已爲 Linux 內核的一部分,默認編譯爲ip_vs模塊。

LVS的優點

LVS的抗併發能力強,主要用於服務器集羣的負載均衡。它工作在網絡層,可以實現高性能,高可用的服務器集羣技術。它廉價,可把許多低性能的服務器組合在一起形成一個超級服務器。它易用,配置非常簡單,且有多種負載均衡的方法。它穩定可靠,即使在集羣的服務器中某臺服務器無法正常工作,也不影響整體效果。另外可擴展性也非常好。

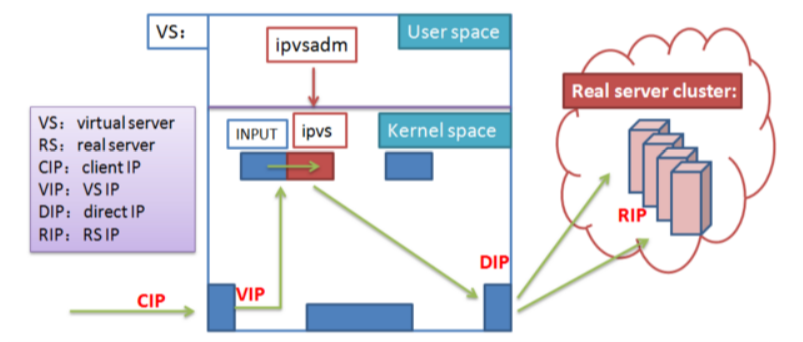

LVS工作原理

VS根據請求報文的目標IP和目標協議及端口將其調度轉發至某RS,根據調度算法來挑選RS

LVS集羣類型中的術語

- VS: Virtual Server, Director Server(DS), Dispatcher(調度器), Load Balancer

- RS: Real Server(lvs), upstream server(nginx), backend server(haproxy)

- CIP: Client IP

- VIP: Virtual serve IP #VS外網的IP,與客戶端相連

- DIP: Director IP #VS內網的IP,與後端服務器相連

- RIP: Real server IP #後端web服務器IP

LVS工作過程

CIP <--> VIP <--> DIP <--> RIP

- 當用戶集中請求 vs 時,由 vs 進行調度到後端RS集羣中,由後端的 RS 集羣進行響應。

- ipvs 存在於 INPUT 鏈上,當用戶的請求報文到達 INPUT 鏈時會首先被 ipvs 進行分析,如果分析到後面的集羣服務器就強行將數據報文送至 POSTROUTING 鏈進行調度轉發至 RS 服務器上。

內核中的LVS

[root@CentOS ~]# grep -i -A 10 "IPVS" /boot/config-3.10.0-862.el7.x86_64

# IPVS transport protocol load balancing support

CONFIG_IP_VS_PROTO_TCP=y # 開啓tcp

CONFIG_IP_VS_PROTO_UDP=y # 開啓udp

CONFIG_IP_VS_PROTO_AH_ESP=y

CONFIG_IP_VS_PROTO_ESP=y

CONFIG_IP_VS_PROTO_AH=y

CONFIG_IP_VS_PROTO_SCTP=y

# IPVS scheduler # 默認支持的算法

CONFIG_IP_VS_RR=m

CONFIG_IP_VS_WRR=m

CONFIG_IP_VS_LC=m

CONFIG_IP_VS_WLC=m

CONFIG_IP_VS_LBLC=m

CONFIG_IP_VS_LBLCR=m

CONFIG_IP_VS_DH=m

CONFIG_IP_VS_SH=m

CONFIG_IP_VS_SED=mLVS集羣工具

- ipvsadm:用戶空間的命令行工具,規則管理器用於管理集羣服務及RealServer

- ipvs:工作於內核空間netfilter的INPUT鉤子上的框架

LVS集羣類型

- lvs-nat:修改請求報文的目標IP,多目標IP的DNAT

- lvs-dr:操縱封裝新的MAC地址

- lvs-tun:在原請求IP報文之外新加一個IP首部

- lvs-fullnat:修改請求報文的源和目標IP

LVS的模式介紹

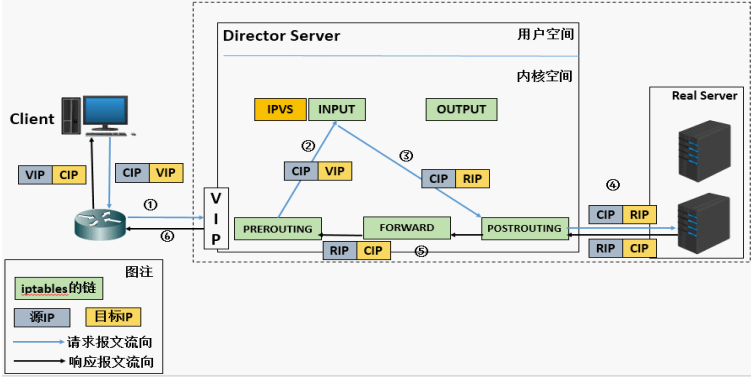

LVS-NAT模式

本質是多目標IP的DNAT,通過將請求報文中的目標地址和目標端口修改爲某挑出的RS的RIP和PORT實現轉發。

(1) RIP和DIP應在同一個IP網絡,且應使用私網地址; RS的網關要指向DIP

(2)請求報文和響應報文都必須經由Director轉發, Director易於成爲系統瓶頸

(3)支持端口映射,可修改請求報文的目標PORT

(4) VS必須是Linux系統, RS可以是任意OS系統

NAT模式IP包調度過程

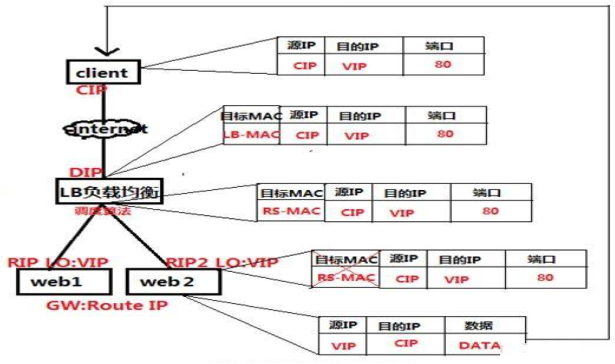

LVS-DR模式

Direct Routing,直接路由,LVS默認模式,應用最廣泛,通過爲請求報文重新封裝一個MAC首部進行轉發,源MAC是DIP所在的接口的MAC,目標MAC是某挑選出的RS的RIP所在接口的MAC地址;源IP/PORT,以及目標IP/PORT均保持不變

(1) Director和各RS都配置有VIP

(2) 確保前端路由器將目標IP爲VIP的請求報文發往Director

- 在前端網關做靜態綁定VIP和Director的MAC地址

- 在RS上使用arptables工具

arptables -A IN -d $VIP -j DROP

arptables -A OUT -s $VIP -j mangle --mangle-ip-s $RIP - 在RS上修改內核參數以限制arp通告及應答級別

/proc/sys/net/ipv4/conf/all/arp_ignore

/proc/sys/net/ipv4/conf/all/arp_announce

(3)RS的RIP可以使用私網地址,也可以是公網地址;RIP與DIP在同一IP網絡;RIP的網關不能指向DIP,以確保響應報文不會經由Director

(4)RS和Director要在同一個物理網絡

(5)請求報文要經由Director,但響應報文不經由Director,而由RS直接發往Client

(6)不支持端口映射(端口不能修敗)

(7)RS可使用大多數OS系統

DR模式IP包調度過程

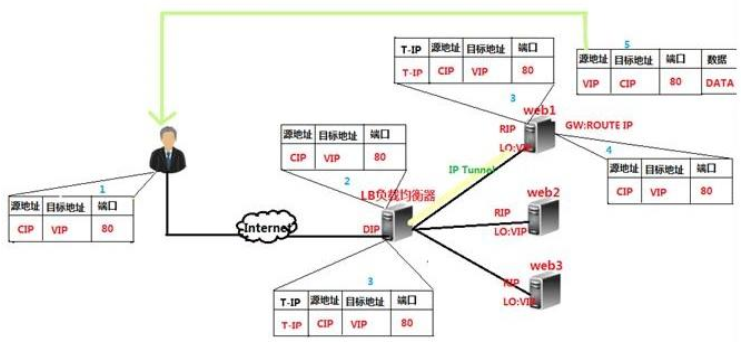

LVS-TUN模式

轉發方式:不修改請求報文的IP首部(源IP爲CIP,目標IP爲VIP),而在原IP報文之外再封裝一個IP首部(源IP是DIP,目標IP是RIP),將報文發往挑選出的目標RS;RS直接響應給客戶端(源IP是VIP,目標IP是CIP)

(1) DIP, VIP, RIP都應該是公網地址

(2) RS的網關一般不能指向DIP

(3) 請求報文要經由Director,但響應不經由Director

(4) 不支持端口映射

(5) RS的OS須支持隧道功能

TUN模式IP包調度過程

LVS-FULLNAT模式

通過同時修改請求報文的源IP地址和目標IP地址進行轉發

CIP --> DIP

VIP --> RIP

(1) VIP是公網地址,RIP和DIP是私網地址,且通常不在同一IP網絡;因此,RIP的網關一般不會指向DIP

(2) RS收到的請求報文源地址是DIP,因此,只需響應給DIP;但Director還要將其發往Client

(3) 請求和響應報文都經由Director

(4) 支持端口映射

注意:此類型kernel默認不支持

LVS模式總結

- lvs-nat與lvs-fullnat:請求和響應報文都經由Director

lvs-nat:RIP的網關要指向DIP

lvs-fullnat:RIP和DIP未必在同一IP網絡,但要能通信 - lvs-dr與lvs-tun:請求報文要經由Director,但響應報文由RS直接發往Client

lvs-dr:通過封裝新的MAC首部實現,通過MAC網絡轉發

lvs-tun:通過在原IP報文外封裝新IP頭實現轉發,支持遠距離通信

LVS調度器根據其調度時RS的負載狀態分爲靜態、動態兩種方法

靜態方法:根據算法本身進行調度

- RR:roundrobin,輪詢

- WRR:Weighted RR,加權輪詢

- SH:Source Hashing,實現session sticky,源IP地址hash;將來自於同一個IP地址的請求始終發往第一次挑中的RS,從而實現會話綁定

- DH:Destination Hashing;目標地址哈希,第一次輪詢調度至RS,後續將發往同一個目標地址的請求始終轉發至第一次挑中的RS,典型使用場景是正向代理緩存場景中的負載均衡,如:寬帶運營商

動態方法:根據RS當前的負載狀態及調度算法進行調度Overhead=value較小的RS將被調度

- LC:least connections 適用於長連接應用

Overhead=activeconns*256+inactiveconns - WLC:Weighted LC,默認調度方法

Overhead=(activeconns*256+inactiveconns)/weight - SED:Shortest Expection Delay,初始連接高權重優先

Overhead=(activeconns+1)*256/weight - NQ:Never Queue,第一輪均勻分配,後續SED

- LBLC:Locality-Based LC,動態的DH算法,使用場景:根據負載狀態實現正向代理

- LBLCR:LBLC with Replication,帶複製功能的LBLC,解決LBLC負載不均衡問題,從負載重的複製到負載輕的RS

ipvsadm工具包

安裝工具包

[root@CentOS7-2 ~]#yum install -y ipvsadm程序包

[root@CentOS7-2 ~]#rpm -ql ipvsadm

/etc/sysconfig/ipvsadm-config # 配置文件

/usr/sbin/ipvsadm # 主程序

/usr/sbin/ipvsadm-restore # 規則重載工具

/usr/sbin/ipvsadm-save # 規則保存工具集羣服務管理

增、改

ipvsadm -A|E -t|u|f service-address [-s scheduler] [-p [timeout]]刪除

ipvsadm -D -t|u|f service-address選項

-A:定義集羣,可以定義多組集羣進行調度

-E:修改定義的集羣

-t: TCP協議的端口,VIP:TCP_PORT

-u: UDP協議的端口,VIP:UDP_PORT

-f:firewall MARK,標記,一個數字

service-address:VIP地址

[-s scheduler]:指定集羣的調度算法,默認爲wlc

[-p [timeout]]:持久綁定時間

-D:刪除集羣

管理集羣上的RS

增、改

ipvsadm -a|e -t|u|f service-address -r server-address [-g|i|m] [-w weight]刪除

ipvsadm -d -t|u|f service-address -r server-address選項

-a:添加集羣成員Real-server

-e:修改集羣成員選項

-r:後端Real-server地址

-g:DR模式

-i:TUN模式

-m:NAT模式,僞裝

[-w weight]:權重,默認爲1

-d:刪除集羣成員

清空定義的所有規則

[root@CentOS7-2 ~]#ipvsadm -C清空計數器

[root@CentOS7-2 ~]#ipvsadm -Z [-t|u|f service-address]查看定義的規則

ipvsadm -L|l [options]

--numeric, -n:以數字形式輸出地址和端口號

--exact:擴展信息,精確值

--connection,-c:當前IPVS連接輸出

--stats:統計信息

--rate:輸出速率信息保存規則

建議保存至/etc/sysconfig/ipvsadm

1. ipvsadm-save > /PATH/TO/IPVSADM_FILE

2. ipvsadm -S > /PATH/TO/IPVSADM_FILE

3. systemctl stop ipvsadm.service重載規則

1. ipvsadm-restore < /PATH/FROM/IPVSADM_FILE

2. ipvsadm -R < /PATH/FROM/IPVSADM_FILE

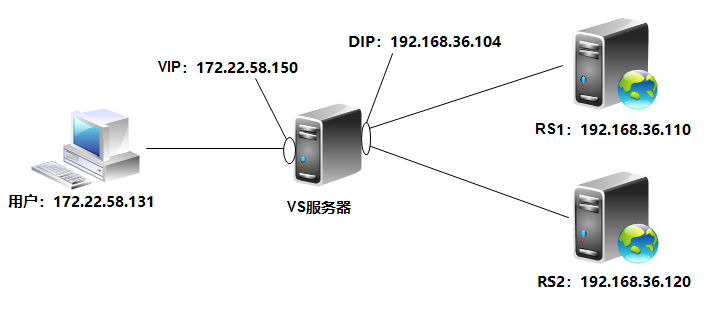

3. systemctl restart ipvsadm.serviceLVS-NAT模式案例

注:實驗之前請先關閉selinux、清空防火牆規則

規劃圖

| 主機名 | IP地址 |

|---|---|

| Client | 172.22.58.131 |

| LVS | 172.22.58.150、192.168.36.104 |

| RS1 | 192.168.36.110 |

| RS2 | 192.168.36.120 |

網絡配置

Client

[root@Client ~]# route -n

Kernel IP routing table

Destination Gateway Genmask Flags Metric Ref Use Iface

172.22.0.0 0.0.0.0 255.255.0.0 U 1 0 0 eth0

0.0.0.0 172.22.58.150 0.0.0.0 UG 0 0 0 eth0Route

[root@LVS ~]#route -n

Kernel IP routing table

Destination Gateway Genmask Flags Metric Ref Use Iface

172.22.0.0 0.0.0.0 255.255.0.0 U 0 0 0 ens37

192.168.36.0 0.0.0.0 255.255.255.0 U 0 0 0 ens33

# 開啓路由轉發功能

[root@LVS ~]#vim /etc/sysctl.conf

net.ipv4.ip_forward = 1

[root@LVS ~]#sysctl -p

net.ipv4.ip_forward = 1RS1

[root@RS1 ~]#route -n

Kernel IP routing table

Destination Gateway Genmask Flags Metric Ref Use Iface

0.0.0.0 192.168.36.104 0.0.0.0 UG 0 0 0 ens33

192.168.36.0 0.0.0.0 255.255.255.0 U 0 0 0 ens33RS2

[root@RS2 ~]# route -n

Kernel IP routing table

Destination Gateway Genmask Flags Metric Ref Use Iface

192.168.36.0 0.0.0.0 255.255.255.0 U 1 0 0 eth0

0.0.0.0 192.168.36.104 0.0.0.0 UG 0 0 0 eth0RS服務器配置

兩臺RS上安裝並啓動Apache服務

[root@RS1 ~]#yum install -y httpd

....

[root@RS1 ~]#systemctl restart httpd創建網頁

[root@RS1 ~]#echo "<h1>Real Server 110</h1>" >/var/www/html/index.html

[root@RS2 ~]#echo "<h1>Real Server 120</h1>" >/var/www/html/index.htmlVS服務器創建規則

# 安裝規則

[root@LVS ~]#yum install -y ipvsadm

# 配置規則

[root@LVS ~]#ipvsadm -A -t 172.22.58.150:80 -s wrr

[root@LVS ~]#ipvsadm -Ln

IP Virtual Server version 1.2.1 (size=4096)

Prot LocalAddress:Port Scheduler Flags

-> RemoteAddress:Port Forward Weight ActiveConn InActConn

TCP 172.22.58.150:80 wrr

[root@LVS ~]#ipvsadm -a -t 172.22.58.150:80 -r 192.168.36.110 -m

[root@LVS ~]#ipvsadm -a -t 172.22.58.150:80 -r 192.168.36.120 -m

[root@LVS ~]#ipvsadm -Ln

IP Virtual Server version 1.2.1 (size=4096)

Prot LocalAddress:Port Scheduler Flags

-> RemoteAddress:Port Forward Weight ActiveConn InActConn

TCP 172.22.58.150:80 wrr

-> 192.168.36.110:80 Masq 1 0 0

-> 192.168.36.120:80 Masq 1 0 0客戶端進行VS測試

[root@Client ~]# while true;do curl http://172.22.58.150;sleep 0.5 ;done

<h1>Real Server 110</h1>

<h1>Real Server 120</h1>

<h1>Real Server 110</h1>

<h1>Real Server 120</h1>

....修改權重值並測試

[root@LVS ~]#ipvsadm -e -t 172.22.58.150:80 -r 192.168.36.110 -m -w 2

[root@LVS ~]#ipvsadm -Ln

IP Virtual Server version 1.2.1 (size=4096)

Prot LocalAddress:Port Scheduler Flags

-> RemoteAddress:Port Forward Weight ActiveConn InActConn

TCP 172.22.58.150:80 wrr

-> 192.168.36.110:80 Masq 2 0 0

-> 192.168.36.120:80 Masq 1 0 0

[root@Client ~]# while true;do curl http://172.22.58.150;sleep 0.5 ;done

<h1>Real Server 120</h1>

<h1>Real Server 110</h1>

<h1>Real Server 110</h1>

<h1>Real Server 120</h1>

<h1>Real Server 110</h1>

<h1>Real Server 110</h1>LVS-DR模式案例

注:實驗之前請先關閉selinux、清空防火牆規則

規劃圖

| 主機名 | IP地址 |

|---|---|

| Client | 172.22.58.113 |

| Route | 172.22.58.150、192.168.36.104 |

| LVS | 192.168.36.106 |

| RS1 | 192.168.36.110 |

| RS2 | 192.168.36.120 |

網絡配置

Client

[root@Client ~]# route -n

Kernel IP routing table

Destination Gateway Genmask Flags Metric Ref Use Iface

172.22.0.0 0.0.0.0 255.255.0.0 U 1 0 0 eth0

0.0.0.0 172.22.58.150 0.0.0.0 UG 0 0 0 eth0Route

[root@Route ~]#route -n

Kernel IP routing table

Destination Gateway Genmask Flags Metric Ref Use Iface

172.22.0.0 0.0.0.0 255.255.0.0 U 0 0 0 ens37

192.168.36.0 0.0.0.0 255.255.255.0 U 0 0 0 ens33

# 開啓路由轉發功能

[root@Route ~]#vim /etc/sysctl.conf

net.ipv4.ip_forward = 1

[root@Route ~]#sysctl -p

net.ipv4.ip_forward = 1LVS

[root@LVS ~]#route -n

Kernel IP routing table

Destination Gateway Genmask Flags Metric Ref Use Iface

0.0.0.0 192.168.36.104 0.0.0.0 UG 0 0 0 ens33

192.168.36.0 0.0.0.0 255.255.255.0 U 0 0 0 ens33RS1

[root@RS1 ~]#route -n

Kernel IP routing table

Destination Gateway Genmask Flags Metric Ref Use Iface

0.0.0.0 192.168.36.104 0.0.0.0 UG 0 0 0 ens33

192.168.36.0 0.0.0.0 255.255.255.0 U 0 0 0 ens33RS2

[root@RS2 ~]# route -n

Kernel IP routing table

Destination Gateway Genmask Flags Metric Ref Use Iface

192.168.36.0 0.0.0.0 255.255.255.0 U 1 0 0 eth0

0.0.0.0 192.168.36.104 0.0.0.0 UG 0 0 0 eth0RS的配置腳本,生成VIP以及測試網頁

分別在RS1、RS2上執行此腳本

[root@RS1 ~]#vim lvs_dr_rs.sh

#!/bin/bash

vip=192.168.36.200

mask='255.255.255.255'

dev=lo:1

rpm -q httpd &> /dev/null || yum -y install httpd &>/dev/null

service httpd start &> /dev/null && echo "The httpd Server is Ready!"

echo "<h1>Real Server 110</h1>" > /var/www/html/index.html

case $1 in

start)

echo 1 > /proc/sys/net/ipv4/conf/all/arp_ignore

echo 1 > /proc/sys/net/ipv4/conf/lo/arp_ignore

echo 2 > /proc/sys/net/ipv4/conf/all/arp_announce

echo 2 > /proc/sys/net/ipv4/conf/lo/arp_announce

ifconfig $dev $vip netmask $mask #broadcast $vip up

#route add -host $vip dev $dev

echo "The RS Server is Ready!"

;;

stop)

ifconfig $dev down

echo 0 > /proc/sys/net/ipv4/conf/all/arp_ignore

echo 0 > /proc/sys/net/ipv4/conf/lo/arp_ignore

echo 0 > /proc/sys/net/ipv4/conf/all/arp_announce

echo 0 > /proc/sys/net/ipv4/conf/lo/arp_announce

echo "The RS Server is Canceled!"

;;

*)

echo "Usage: $(basename $0) start|stop"

exit 1

;;

esac

[root@RS2 ~]# bash ./lvs_dr_rs.sh start

The httpd Server is Ready!

The RS Server is Ready!注:

- 限制響應級別:arp_ignore

0:默認值,表示可使用本地任意接口上配置的任意地址進行響應

1: 僅在請求的目標IP配置在本地主機的接收到請求報文的接口上時,纔給予響應 - 限制通告級別:arp_announce

0:默認值,把本機所有接口的所有信息向每個接口的網絡進行通告

1:儘量避免將接口信息向非直接連接網絡進行通告

2:必須避免將接口信息向非本網絡進行通告

VS的配置腳本,生成調度規則

[root@LVS ~]#vim lvs_dr_vs.sh

#!/bin/bash

vip='192.168.36.200'

iface='lo:1'

mask='255.255.255.255'

port='80'

rs1='192.168.36.110'

rs2='192.168.36.120'

scheduler='wrr'

type='-g'

# rpm -q ipvsadm &> /dev/null || yum -y install ipvsadm &> /dev/null

case $1 in

start)

ifconfig $iface $vip netmask $mask #broadcast $vip up

iptables -F

ipvsadm -A -t ${vip}:${port} -s $scheduler

ipvsadm -a -t ${vip}:${port} -r ${rs1} $type -w 1

ipvsadm -a -t ${vip}:${port} -r ${rs2} $type -w 1

echo "The VS Server is Ready!"

;;

stop)

ipvsadm -C

ifconfig $iface down

echo "The VS Server is Canceled!"

;;

*)

echo "Usage: $(basename $0) start|stop"

exit 1

;;

esac

執行腳本,生成規則

[root@LVS ~]#bash ./lvs_dr_vs.sh start

The VS Server is Ready!規則查看

[root@LVS ~]#ipvsadm -Ln

IP Virtual Server version 1.2.1 (size=4096)

Prot LocalAddress:Port Scheduler Flags

-> RemoteAddress:Port Forward Weight ActiveConn InActConn

TCP 192.168.36.200:80 wrr

-> 192.168.36.110:80 Route 1 0 0

-> 192.168.36.120:80 Route 1 0 0調度測試

[root@Client ~]# while true;do curl http://192.168.36.200;sleep 0.5 ;done

<h1>Real Server 110</h1>

<h1>Real Server 120</h1>

<h1>Real Server 110</h1>

<h1>Real Server 120</h1>

<h1>Real Server 110</h1>

<h1>Real Server 120</h1>

....修改權重,進行測試

[root@LVS ~]#ipvsadm -e -t 192.168.36.200:80 -r 192.168.36.120 -g -w 3

[root@Client ~]# while true;do curl http://192.168.36.200;sleep 0.5 ;done

<h1>Real Server 110</h1>

<h1>Real Server 120</h1>

<h1>Real Server 120</h1>

<h1>Real Server 120</h1>

<h1>Real Server 110</h1>

<h1>Real Server 120</h1>

<h1>Real Server 120</h1>

<h1>Real Server 120</h1>

....FireWall Mark

定義

藉助於防火牆標記來分類報文,而後基於標記定義集羣服務;可將多個不同的應用使用同一個集羣服務進行調度。

在LVS-NAT基礎上進行配置

清空ipvsadm配置

[root@LVS ~]#ipvsadm -C

[root@LVS ~]#ipvsadm -Ln

IP Virtual Server version 1.2.1 (size=4096)

Prot LocalAddress:Port Scheduler Flags

-> RemoteAddress:Port Forward Weight ActiveConn InActConn設置防火牆標記位

[root@LVS ~]#iptables -t mangle -A PREROUTING -d 192.168.36.104 -p tcp -m multiport --dports 80,443 -j MARK --set-mark 10

[root@LVS ~]#iptables -vnL -t mangle

Chain PREROUTING (policy ACCEPT 105 packets, 7292 bytes)

pkts bytes target prot opt in out source destination

0 0 MARK tcp -- * * 0.0.0.0/0 192.168.36.104 multiport dports 80,443 MARKset 0xa

# MARK 用於給特定的報文打標記

# --set-mark value

# 其中:value 可爲0xffff格式,表示十六進制數字根據標記位配置ipvsadm調度規則

[root@LVS ~]#ipvsadm -A -f 10 -s wrr

[root@LVS ~]#ipvsadm -Ln

IP Virtual Server version 1.2.1 (size=4096)

Prot LocalAddress:Port Scheduler Flags

-> RemoteAddress:Port Forward Weight ActiveConn InActConn

FWM 10 wrr

[root@LVS ~]#ipvsadm -a -f 10 -r 192.168.36.110 -m

[root@LVS ~]#ipvsadm -a -f 10 -r 192.168.36.120 -m

[root@LVS ~]#ipvsadm -Ln

IP Virtual Server version 1.2.1 (size=4096)

Prot LocalAddress:Port Scheduler Flags

-> RemoteAddress:Port Forward Weight ActiveConn InActConn

FWM 10 wrr

-> 192.168.36.110:0 Masq 1 0 0

-> 192.168.36.120:0 Masq 1 0 0持久連接

session綁定:對共享同一組RS的多個集羣服務,需要統一進行綁定,LVS SH算法無法實現。

持久連接( lvs persistence )模板:實現無論使用任何調度算法,在一段時間內(默認360s ),能夠實現將來自同一個地址的請求始終發往同一個RS

ipvsadm -A|E -t|u|f service-address [-s scheduler] [-p [timeout]]持久連接實現方式:

- 每端口持久(PPC):每個端口定義爲一個集羣服務,每集羣服務單獨調度

- 每防火牆標記持久(PFWMC):基於防火牆標記定義集羣服務;可實現將多個端口上的應用統一調度,即所謂的port Affinity

- 每客戶端持久(PCC):基於0端口(表示所有服務)定義集羣服務,即將客戶端對所有應用的請求都調度至後端主機,必須定義爲持久模式

在FireWall Mark基礎上進行測試

[root@LVS ~]#ipvsadm -E -f 10 -s wrr -p

# -p:持久連接綁定,單位/s,默認爲360s